Die Speaker für den World of Data 2026 stehen in den Startlöchern.

Entdecke unser inspirierendes Line-up:

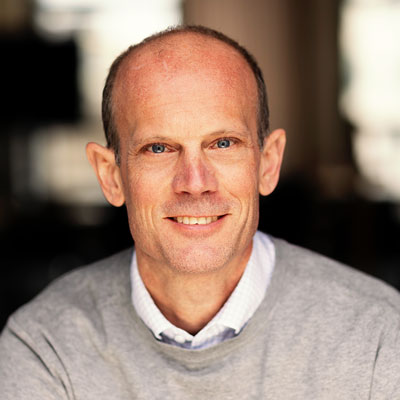

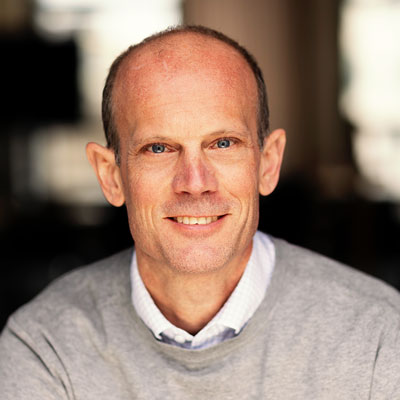

Tim ist ein erfahrener Data Engineer mit langjähriger Berufserfahrung und hat in verschiedensten Branchen und mit unterschiedlichen Technologien gearbeitet. Er ist versiert darin, Teams zu führen, Datenlösungen zu entwickeln und aus Daten wertvolle Insights abzuleiten, um Unternehmensziele zu unterstützen. Eine weitere Leidenschaft von ihm ist es, Teamprozesse zu optimieren und zu automatisieren, mit Fokus auf DataOps und DevOps.

Germany’s “Energiewende” represents an ambitious and necessary transformation. This shift brings both significant technological innovation and digital challenges. 50Hertz is committed to leading the integration of renewable energy and is therefore developing a new control system. Data is essential to achieving this vision and enabling a sustainable, future-proof power grid.

Jochen ist seit mehreren Jahren bei der Atruvia AG tätig und dort unter anderem für die Umsetzung der Datenstrategie sowie die Weiterentwicklung analytischer Plattformen verantwortlich. Zuvor sammelte er vielseitige Berufserfahrung als Full-Stack Software Developer, Data Engineer, DevOps Engineer und IT-Architekt.

Das Thema der digitalen Souveränität hat im europäischen Raum in den letzten Jahren enorm an Wichtigkeit gewonnen. Geopolitische Risiken, Abhängigkeiten aufgrund internationaler Verflechtungen, globale Krisen oder gar Kriege sind aufgrund der jüngsten Geschichte längst kein abstraktes Bedrohungsszenarion mehr. Dieser Vortrag beschreibt mögliche Vorgehen für Unternehmen, die nach Strategien zur Reduktion von Abhängigkeiten, zur Stärkung der Kontrolle über ihre Daten sowie zur Gestaltung resilienter Datenarchitekturen suchen und daraufhin gezielte Technologieentscheidungen treffen wollen.

Jan ist Rechtsanwalt/Partner bei avocado rechtsanwälte und leitet den Fachbereich „Geistiges Eigentum, Medien und Informationstechnologie“. Seit vielen Jahren berät er Unternehmen in Projekten und Verfahren rund um IT, Datenschutz und Telekommunikation (Digitalisierungsprojekte, Künstliche Intelligenz, Einführung neuer IT-Systeme bzw. Produkte, IT-Outsourcing- und Business Process Outsourcing etc.). Zudem tritt er regelmäßig als Referent bei Fachveranstaltungen auf.

Praktische Umsetzung des EU AI Acts und wie man Governance als strategischen Wettbewerbsvorteil nutzt.

Arndt ist auf Advanced Analytics, Business Intelligence und Cloud-Initiativen spezialisiert. Mit seiner Expertise im Aufbau moderner Data Stacks nutzt er Technologien wie SAP S/4HANA, BigQuery und die Google Cloud Platform für datengetriebene Lösungen, darunter statistische Prognosen und Machine-Learning-Anwendungen.

What happens when you combine a massive Google Cloud transformation with a simultaneous S/4 HANA migration? You get a masterclass in complexity—and a lot of lessons learned the hard way. We’re pulling back the curtain on our journey, moving beyond the slides to discuss the pitfalls of dual transformations and the "scars" we earned along the way. We focus specifically on the technical integration and strategic data usage that bridge these two worlds. From the failures that stalled us to the high-impact use cases that saved us, this is a story of heartbreak, hard work, and—eventually—a data-driven transformation that actually works.

Friedrich ist Co-Founder und Managing Director der Berlin Bytes GmbH in Berlin und verantwortet als Head of Tech die technologische Ausrichtung des Unternehmens. Mit seinem Team entwickelt er digitale Produkte, User Experiences und datengetriebene Lösungen für Kunden aus unterschiedlichen Branchen.

Fokus auf den echten ROI der KI-Transformation und strategische Priorisierung anhand von simplen Case Studies oder Expertenrunden.

Bilal ist renommierter Keynote-Speaker, Unternehmer und Experte für KI. Er studierte BWL in Düsseldorf, ist regelmäßig im Silicon Valley und absolvierte KI-Kurse in den USA an den Eliteuniversitäten Harvard und Stanford. Er zählt zu den gefragtesten Speakern in Deutschland sowie Europa und wird regelmäßig von internationalen Unternehmen engagiert. Zudem ist Bilal aus verschiedenen TV-Formaten bekannt. Im September ist sein erstes Buch “Der klügste Freund, den wir je hatten” im Buchhandel erschienen.

„Jahrhundert-Chance: KI“ ist eine interaktive Keynote, die einen kompakten Überblick über den aktuellen Stand der Künstlichen Intelligenz weltweit gibt – mit frischen Einblicken aus dem Silicon Valley, China und Europa. Anhand konkreter Beispiele werden Anwendungsmöglichkeiten von KI in Unternehmen, im Alltag sowie ihre sozialen Auswirkungen beleuchtet. Zudem zeigt die Keynote, wie KI Medizin und Gesundheit verändert und bietet persönliche Einblicke in die zugrunde liegenden Technologien – verständlich, inspirierend und praxisnah.

Klaus Blaschek berät als Gründer und Geschäftsführer von b.telligent seit über 20 Jahren Kunden in den Themen BI, Data Warehouse und Customer Intelligence. Seine Projekterfahrung umfasst anspruchsvolle, internationale Projektvorhaben und den kompletten Wertschöpfungsprozess. Dabei hat er als Wahl-Schweizer nicht nur die Telekommunikations- und Finanzdienstleistungsbranche fest im Fokus, sondern auch die Schweizer Berge.

Wolf verfügt über 20 Jahre Erfahrung in einem breiten Bereich des Datenmanagements (DWH, BI, CRM, Big Data) in unterschiedlichen Branchen (Telekommunikation, Banken und Handel).

Ehrliche Erfahrungsberichte über die Skalierung von KI-Projekten – von den Herausforderungen in der Praxis bis zu den Lessons Learned.

Sebastian Amtage ist Gründer und geschäftsführender Gesellschafter von b.telligent. In den Themen Customer Relationship Management, Data Management und Data Science ist er seit über 20 Jahren zuhause und unterstützt Kunden entlang der gesamten Wertschöpfungskette. Für Sebastian zählt nur eins: die Daten!

Silvia ist Industry Practice Lead Healthcare & Pharma bei b.telligent und verfügt über 30 Jahre Erfahrung im Daten- und Healthcare-Sektor. In Führungspositionen bei Big-4-Beratungen sowie in der internationalen Spitzenforschung hat sie die datengetriebene Transformation der Gesundheitsbranche maßgeblich mitgestaltet. Ihr Fokus liegt auf sicheren, hybriden Gesundheitsdatenplattformen, messbarem Nutzen und flexiblen Fit-for-Purpose-Strategien, die bewährte Ansätze intelligent und effizient nutzbar machen.

- Den richtigen Reifegrad für KI finden: praxisnah, validiert und klar auf klinischen, operativen oder geschäftlichen Mehrwert ausgerichtet.

- Das Rad nicht neu erfinden: bewährte Modelle, Plattformen, Standards und Best Practices gezielt nutzen.

- Von Experimenten zu echter Wirkung kommen – mit skalierbaren, compliant und menschenzentrierten KI-Lösungen.

Kai ist seit 2025 Teil der Geschäftsführung von b.telligent und bringt über zwei Jahrzehnte Führungserfahrung in den Bereichen Daten, Technologie, Analytics und AI mit. Bei b.telligent verantwortet er die Weiterentwicklung der Gruppenstrategie, M&A sowie den Managementnachwuchs. Sein Fokus liegt dabei auf Wachstum, Skalierung und Innovation im datengetriebenen Business.

Lennart ist ein erfahrener Data Strategy Consultant, Solution Architect, und Business Analyst mit über einer Dekade Erfahrung im Datenmanagement sowie in der Entwicklung ganzheitlicher Data-, Analytics- und AI-Strategien.

Ehrliche Erfahrungsberichte über die Skalierung von KI-Projekten – von den Herausforderungen in der Praxis bis zu den Lessons Learned.

tba

Football fans today are more diverse than ever in how they follow the sport and how they consume media. For the Bundesliga, competing not just with other leagues but with the entire digital media landscape, putting the fan at the center is no longer a nice-to-have. In this Breaktalk, Uwe Vocks pulls back the curtain on the MarTech stack powering Bundesliga's fan engagement strategy. He'll walk through how are combining zero- and first-party data for personalized fan engagement leveraging the Bundesliga's Fan Data Lake and Tealium as a Customer Data Platform. The session will also explore how predictive attribute modelling and audience segmentation enable more precise, scalable personalization, turning data signals into experiences that genuinely resonate. This session offers a practical blueprint for making fan or customer centricity a reality.

Michael ist für das Cloud Program Management bei Controlware im Bereich Business Development verantwortlich. Er gestaltet die Partnerschaften mit AWS, HashiCorp an IBM Company, OVHcloud und Google GCP. Er verfügt über mehr als 25 Jahre internationaler ITK-Erfahrung in der IT-, Finanz-, Automobil-, Fertigungs- und Luftfahrtbranche.

Im Dialog mit Ihnen und Controlware Service-Entwickler*innen. Die Integration von Künstlicher Intelligenz in Organisationen ist kein rein technisches Projekt – sie ist ein tiefgreifender Veränderungsprozess, der Menschen, Strukturen und Kulturen gleichermaßen berührt. Welche Hürden begegnen uns? In der Praxis zeigen sich vielfältige Hindernisse: fehlende souveräne digitale Infrastruktur, unklare Datenschutzvorgaben, mangelndes Vertrauen in KI-gestützte Entscheidungen sowie Unsicherheiten bei Mitarbeitenden über Rollenveränderungen und Jobsicherheit. Häufig fehlt auch eine klare Strategie, die technische Möglichkeiten mit konkreten Mehrwerten verbindet. Welche Perspektiven müssen wir einbeziehen? Eine erfolgreiche Einführung erfordert den Blick aus verschiedenen Richtungen: die Führungsperspektive mit strategischer Verantwortung, die Mitarbeitendenperspektive mit Fokus auf Akzeptanz und Qualifizierung, die ethische Perspektive hinsichtlich Fairness und Transparenz sowie die Kundenperspektive, die Vertrauen und Nutzen in den Mittelpunkt stellt. Dieser Erfahrungsaustausch bietet Raum, offen über Herausforderungen zu sprechen, voneinander zu lernen und gemeinsam realistische Wege zu entwickeln – jenseits von Hype und Skepsis. Denn gelungene KI-Nutzung entsteht nicht durch Technologie allein, sondern durch Menschen, die sie bewusst und verantwortungsvoll gestalten.

Andrea ist Consultant für Marketing/Vertriebs Solutions bei Cornelsen mit Schwerpunkt auf Anforderungsanalyse und Systemumsetzung. Sie verfügt über langjährige Erfahrung in Marketingservices, Planungsprozessen sowie Prozessberatung und -implementierung. Zusätzlich verfügt sie über Erfahrung im Projektmanagement und in der Prozessoptimierung im Einklang mit systemischer Unterstützung.

Der Vortrag zeigt, wie der Cornelsen Verlag MARMIND als zentrales Steuerungsinstrument für Marketingaktivitäten etabliert und nahtlos mit SAP verzahnt hat. Im Fokus stehen die Neugestaltung der Planungs- und Freigabeprozesse, eine einheitliche Datenbasis sowie die Konzeption der Schnittstellen zwischen beiden Systemen. Die Projektreise – von den ersten Anforderungen bis zum laufenden Betrieb – liefert Einblicke, Erfolgsfaktoren und Lessons Learned für ähnliche Integrationsvorhaben.

Carsten verfügt über mehr als 20 Jahre Berufserfahrung, davon 15 Jahre im Consulting mit Schwerpunkt Business Intelligence und Data Warehousing. Nach seinem Wirtschaftsinformatik-Studium bei HP sammelte er erste Business-Intelligence-Erfahrungen im Controlling und verantwortete zahlreiche Data-Warehouse-Projekte, unter anderem als Requirements Engineer, Architekt sowie Datenbank- und ETL-Entwickler. Sein fachlicher Fokus liegt auf Automatisierung, API-Entwicklung, Operations und Support sowie dem Aufbau nachhaltiger, skalierbarer Datenarchitekturen. In den vergangenen zehn Jahren begleitete er als Scrum Master und Agile Coach über 25 Teams in Transformationsprozessen. Seit 2024 ist er als Data & AI Enabler bei der 2150 Datavault Builder AG tätig. Dort verantwortet er unter anderem GenAI-basiertes Wissensmanagement, die Integration moderner AI-Architekturen einschließlich MCP-Servern sowie das Online-Training- und Certification-Programm.

Datenmodellierung ist oft abhängig von Erfahrung, Kontextwissen und vielen manuellen Schritten. KI kann diesen Prozess sinnvoll unterstützen. In diesem Talk zeige ich in einer Live-Demo von Anfang bis Ende, wie KI-Agenten den Weg von der fachlichen Anforderung bis zur Datenabfrage im DWH-Prozess unterstützen. Du siehst:

1) ... wie aus einer fachlichen Beschreibung und bestehenden Quelldatenmodellen direkt ein Data Vault Modell entsteht.

2) ... wie das Modell per MCP Server regelkonform, konsistent und nachvollziehbar auf der Datenbank umgesetzt wird.

3) ... wie Daten per natürlicher Sprache abgefragt werden können – ohne SQL-Kenntnisse.

Das Model Context Protocol (MCP) verbindet KI-Agenten direkt mit Modellierungswerkzeugen und Datenbanken. So wird aus einem Chatbot ein echter Arbeitsassistent. Eines vorweg: KI übernimmt das Handwerk. Die Architekturentscheidungen bleiben (noch) beim Menschen. Erlebe eine Live-Demo auf Basis von Datavault Builder und Database MCP Servern.

Als Chief Solution Architect gestaltet Johannes seit über 12 Jahren bei disy zukunftsfähige Lösungen für souveräne Dateninfrastrukturen, Datenplattformen und datenbasierte Entscheidungsunterstützung. Sein Fokus liegt darauf, mit disy Cadenza Fachlichkeit, moderne Datenanalyse und Location Intelligence zu einer leistungsfähigen, souveränen Analyseplattform zu verbinden, die Organisationen nachhaltige Handlungsfähigkeit und fundierte Entscheidungen ermöglicht.

Viele Organisationen setzen auf globale Lösungen für die Speicherung, Verarbeitung und Analyse ihrer Daten. Gleichzeitig wächst das Bewusstsein für die Risiken einseitiger Abhängigkeiten:

- fehlende Interoperabilität und eingeschränkte Datenportabilität,

- Zugriffsgesetze, die Kontrolle über Daten untergraben und

- KI-Dienste ohne Transparenz über Datenverarbeitung und Rechtsrahmen.

Digitale Souveränität ist dabei mehr als eine technische Frage – sie ist eine politische und gesellschaftliche Notwendigkeit: die Fähigkeit von Staaten, Unternehmen und Verwaltungen, ihre digitalen Infrastrukturen und Daten eigenständig zu kontrollieren und selbstbestimmt als Gestaltungsmittel einzusetzen.

Wie können Dateninfrastrukturen so aufgebaut werden, dass sie Flexibilität, Skalierbarkeit und selbstbestimmte Nutzung ermöglichen – und gleichzeitig einseitige Abhängigkeiten vermeiden? In dieser 120-minütigen Masterclass zeigen vier Experten, wie mit state-of-the-art Technologien Datenpipelines, KI-Analyseplattformen und Cloud-Infrastrukturen souverän gestaltet werden können. Es werden strategische Entscheidungsgrundlagen und technische Umsetzungsmöglichkeiten vorgestellt und diskutiert.

Agenda

00:00 – 00:10 | Begrüßung & Keynote Souveränität beginnt beim Fundament

00:10 – 00:30 | Stackable Open Source Data Stack: Daten-Orchestrierung mit der Stackable Data Platform

00:30 – 00:50 | Red Hat OpenShift AI: Die souveräne Cloud-Plattform für geschäftskritische Daten- und KI-Workloads

00:50 – 01:10 | IONOS Der souveräne Cloud-Maschinenraum: Infrastruktur ohne Backdoor

01:10 – 01:30 | disy Informationssysteme Souveräne Datenanalyse: Die eigenen Daten als Gestaltungsmittel nutzen

01:30 – 02:00 | Deep Dive & Panel-Diskussion Quo vadis, Sovereign Stack?

Sandra bewegt sich an der Schnittstelle von Fachlichkeit, Daten und Technologie. Bei disy begleitet sie Organisationen dabei, komplexe Fragestellungen in klare Analyseansätze und tragfähige datenbasierte Prozesse zu übersetzen. Ihr Schwerpunkt liegt in der Beratung zum Einsatz von disy Cadenza als Lösung für Business & Location Intelligence – mit modernen Reporting-, Analytics- und KI-Funktionen für eine souveräne Datennutzung.

Viele Organisationen setzen auf globale Lösungen für die Speicherung, Verarbeitung und Analyse ihrer Daten. Gleichzeitig wächst das Bewusstsein für die Risiken einseitiger Abhängigkeiten:

- fehlende Interoperabilität und eingeschränkte Datenportabilität,

- Zugriffsgesetze, die Kontrolle über Daten untergraben und

- KI-Dienste ohne Transparenz über Datenverarbeitung und Rechtsrahmen.

Digitale Souveränität ist dabei mehr als eine technische Frage – sie ist eine politische und gesellschaftliche Notwendigkeit: die Fähigkeit von Staaten, Unternehmen und Verwaltungen, ihre digitalen Infrastrukturen und Daten eigenständig zu kontrollieren und selbstbestimmt als Gestaltungsmittel einzusetzen.

Wie können Dateninfrastrukturen so aufgebaut werden, dass sie Flexibilität, Skalierbarkeit und selbstbestimmte Nutzung ermöglichen – und gleichzeitig einseitige Abhängigkeiten vermeiden? In dieser 120-minütigen Masterclass zeigen vier Experten, wie mit state-of-the-art Technologien Datenpipelines, KI-Analyseplattformen und Cloud-Infrastrukturen souverän gestaltet werden können. Es werden strategische Entscheidungsgrundlagen und technische Umsetzungsmöglichkeiten vorgestellt und diskutiert.

Agenda

00:00 – 00:10 | Begrüßung & Keynote Souveränität beginnt beim Fundament

00:10 – 00:30 | Stackable Open Source Data Stack: Daten-Orchestrierung mit der Stackable Data Platform

00:30 – 00:50 | Red Hat OpenShift AI: Die souveräne Cloud-Plattform für geschäftskritische Daten- und KI-Workloads

00:50 – 01:10 | IONOS Der souveräne Cloud-Maschinenraum: Infrastruktur ohne Backdoor

01:10 – 01:30 | disy Informationssysteme Souveräne Datenanalyse: Die eigenen Daten als Gestaltungsmittel nutzen

01:30 – 02:00 | Deep Dive & Panel-Diskussion Quo vadis, Sovereign Stack?

Anja ist Head of Data Governance & Enterprise Reporting bei DKV Mobility und verantwortet dort eines der zentralen Unternehmens Assets: Daten. Ihr Fokus liegt darauf, durch eine klare Daten Strategie und gezielte Governance Initiativen die Datenqualität, Datensicherheit und den verantwortungsvollen Umgang mit Daten im gesamten Unternehmen zu stärken. Sie treibt bei DKV Mobility die Weiterentwicklung einer modernen Datenorganisation voran, unterstützt Mitarbeitende bei der effektiven Nutzung von Daten und begleitet den Aufbau eines strukturierten Data Product Managements. Dank ihrer langjährigen internationalen Erfahrung in Datenanalyse, Master Data Management, Data Governance, Management und Strategie verbindet sie fachliche Expertise mit einem praxisnahen, businessorientierten Ansatz.

Daten & AI sind heute mehr als Technologie, vielmehr haben sie sich zu einem strategischen Wachstumstreiber entwickelt. Dieser Vortrag zeigt, wie die intelligente Nutzung von Daten Unternehmen schneller, effizienter und erfolgreicher macht. Er beleuchtet, warum moderne Datenarchitekturen und leistungsfähige Data Products oft die unsichtbaren Helden von Data-&-AI-Strategien sind, wie eine aktiv gelebte Data Culture datengetriebenes Handeln im gesamten Unternehmen verankert und wie Data & AI konkret in messbaren Business Value übersetzt werden, mit direkter Wirkung auf Ergebnis, Wachstum und Wettbewerbsfähigkeit.

Yannick leitet das KI & Daten-Team der Deutschen Presse-Agentur (dpa), der größten Nachrichtenagentur Deutschlands. Nach seinem Master in Management & Data Science sammelte Yannick mehrere Jahre Erfahrung als Data Scientist und Teamleiter in der IT-Beratung. Seit Anfang 2025 entwickelt sein Team innovative KI-Lösungen im Medien- und Informationsökosystem.

KI-Systeme sind nur so gut wie die Informationen, auf deren Basis sie Entscheidungen treffen. Mit dpa-iq bauen wir eine Retrieval-Infrastruktur auf AWS und Databricks, die verifizierte Informationen & Content in Echtzeit an LLM-basierte Agenten liefert - für interne Produktteams und externe Kunden gleichermaßen. Ein Blick hinter die Kulissen: Herausforderungen, Architektur und Umsetzung einer Plattform, die als Grounding-Backbone für agentische Workflows & Produkte dient.

Alex Merced ist Head of DevRel bei Dremio und bringt Erfahrung als Entwickler und Trainer mit. Seine berufliche Laufbahn umfasst Stationen bei GenEd Systems, Crossfield Digital, CampusGuard und General Assembly. Er ist Co-Autor von „Apache Iceberg: The Definitive Guide“ und „Apache Polaris: The Definitive Guide“, beide erschienen bei O’Reilly, sowie von „Architecting an Apache Iceberg Lakehouse“ bei Manning. Alex hat weltweit auf namhaften Events gesprochen, darunter SQLbits, DataEngBytes, Data Day Texas, Data Council und weitere. Er ist begeistert von Technologie und teilt seine Expertise über Blogs, Videos und seinen Podcast „Alex Merced's Tech Podcast“. Außerdem hat er mit Libraries wie SencilloDB und CoquitoJS Beiträge zu den JavaScript-, Rust- und Python-Communities geleistet. Zudem ist er der Entwickler des Pangolin Open Source Lakehouse Catalog.

Teams invested in lakehouses, pipelines, and dashboards. Yet trust in data remains low. Analysts still duplicate logic. AI systems struggle to act on incomplete context. The root cause is simple: semantics never kept up.

This session breaks down how fragmented definitions and siloed logic limit both analytics and AI. It then introduces a unified semantic layer that spans all data sources without duplication. Built on open architecture, this layer brings consistent meaning to every query, model, and application. When semantics are shared, data stops being a bottleneck and becomes a reliable foundation for action.

Takeaways:

1) Why semantic drift creates hidden data debt.

2) How poor context weakens AI outcomes.

3) Where semantics should live in a modern architecture.

4) How to create reusable, governed business logic at scale.

Steffen ist Head of Data & Platforms bei ERBACHER – the food family und verbindet Data, KI und E Commerce mit Prozessdigitalisierung und -optimierung. Er verantwortet Teams u. a. in AI, Data Analytics und digitalen Projekten. Damit unterstützt er den Aufbau skalierbarer Daten- und Plattformstrukturen und den Roll-out von KI, sowohl technisch als auch kulturell. Zudem teilt er seine Erfahrungen als Speaker zu Themen wie Data, Digital Transformation und KI.

Podiumsdiskussion und Publikums-Q&A. Diskussion über die Entscheidung zwischen Eigenentwicklung, Kauf und Kooperation mit Fokus auf Datensouveränität und DSGVO.

Claudia verfügt über 20 Jahre Berufserfahrung in den Bereichen Data Science, Artificial Intelligence und Innovation Management. Als Chief Data Officer bei der FIEGE Logistik ist sie zentral für die Daten und KI-Themen zuständig. Bis Sommer 2024 leitete sie bei der Deutschen Bahn das Data Intelligence Center und verantwortete die Daten & KI Strategie des Konzerns. Davor leitete sie das Machine Learning Team bei den T-Labs, der Forschungseinheit der Deutschen Telekom. Nebenher ist Claudia Angel Investorin. Sie ist Speakerin sowie Autorin und engagiert sich für die Bildung von Kindern und jungen Menschen im Bereich Daten & KI. Claudia wurde vielfach ausgezeichnet: 2019 als „Global Women Leader in AI“, „40 over 40 – Germany's Most Inspiring Women 2022“, als eine von „30 Outstanding Women in Data – 2023 Global Recognition“ und kürzlich mit dem ILD Leadership Award 2025 in der Kategorie „Inspiring Leader“.

KI rennt uns allen davon, doch wir frickeln noch an den Daten rum. Claudia Pohlink gibt Antworten aus dem Maschinenraum: dort, wo Datenqualität, Governance und operative Realität darüber entscheiden, ob KI-Projekte skalieren oder scheitern. Sie zeigt, wie ein klassisches Logistikunternehmen den Weg von der Datenstrategie zur messbaren KI-Wertschöpfung geht – mit all seinen Umwegen, Rückschlägen und echten Erfolgen. Kein Hochglanz, kein Buzzword-Bingo. Sondern Klartext und der Anti-Hype.

Simon ist eine erfahrene Führungspersönlichkeit für Transformationen, Datenstrategien, Digitalisierungsinitiativen und Prozessoptimierungen. Als Global Head of Data Excellence bei der Giesecke+Devrient GmbH verantwortet er den globalen Umgang mit Daten sowie verschiedene Transformationsprogramme. Zuvor war er in leitenden Rollen bei UniCredit und PwC tätig mit Fokus auf Strategieentwicklung, Target Operating Models sowie Banking-Digitalisierung.

Thomas ist Head of Data-Driven Applications & Services bei GRENKE in Baden-Baden. GRENKE ist ein Finanzlösungsanbieter, der Dienstleistungen in mehr als 30 Ländern weltweit anbietet. Seine Abteilung hat das Ziel, geschäftlichen Mehrwert durch Daten sowie datenbezogene Services und Anwendungen zu liefern. Er hat die letzten 20 Jahre mit Daten, Datenbanken, IT-Services und zugehöriger Infrastruktur verbracht. Davor war er Rettungssanitäter beim Deutschen Roten Kreuz.

Organizations sit on mountains of data, yet without a strategy, they risk sinking into a swamp of disorganized information, where potential insights are lost. Many companies treat data as a commodity rather than a strategic driver, leaving untapped potential on the table. This session explores how organizations can move beyond reactive data management and establish a forward-looking strategy that aligns with business goals. Whether you're a DBA, data scientist, or manager, the first step is asking why your data matters, what value it brings, and how it can empower decision-making. We will identify why data initiatives fail and data strategies fall short. You'll see how defining a clear vision anchors your strategy. We'll discuss how to build a culture that embraces data as a strategic asset, not just a technical tool. Crucially, we will explore the human side of data because data is only as valuable as the impact it creates for the people who use it. Discover why your data strategy might be doomed before it starts and what you can do about it before you're knee-deep in the swamp.

Tamara ist Datenanalystin in der E‑Mobilität mit dem Schwerpunkt auf der Digitalisierung von Fertigungslinien. Ihr Fokus liegt darauf, Maschinen‑ und Produktdaten in Echtzeit für Anwender nutzbar zu machen, um datengetriebene Prozessoptimierungen zu ermöglichen und die Transparenz in der Linieninbetriebnahme nachhaltig zu erhöhen. Aufbauend auf der Erfahrung in der Projektkoordination der Produktreifegradentwicklung elektrischer Antriebe.

Der Vortrag beschreibt die datenarchitektonische Transformation eines Maschinenbauunternehmens, das gemeinsam mit b.telligent Microsoft Fabric zur Ablösung von SAP BW implementiert hat. Aus einem zunächst SAP fokussierten Projekt entstand ein Multisource Setup mit REST APIs, Kafka Eventstreams, SQL Datenbanken, usw. – aufgebaut im domänenübergreifenden Hub and Spoke System und ausgerichtet auf einen Single Point of Truth. Die Architektur verbindet dabei die SAP Lakehouse Welten mit hochfrequenten Engineering Datenströmen. Besonders im Engineering steht Self Service in Echtzeit Dashboards mit KQL Querysets im Mittelpunkt, um Fachbereiche nachhaltig zu befähigen.

Thomas ist Controller bei den GROB‑Werken mit Schwerpunkt auf Reporting und Projektanalyse. In seiner Rolle als Projektleiter verantwortet er zudem die BI‑Strategie der GROB‑Gruppe. Er bringt langjährige Erfahrung im Controlling, in der Projektsteuerung und im Management‑Reporting mit und verfügt über tiefgehendes, modulübergreifendes SAP‑Know‑how sowie umfassende Expertise in der Weiterentwicklung datenbasierter Steuerungsprozesse.

Der Vortrag beschreibt die datenarchitektonische Transformation eines Maschinenbauunternehmens, das gemeinsam mit b.telligent Microsoft Fabric zur Ablösung von SAP BW implementiert hat. Aus einem zunächst SAP fokussierten Projekt entstand ein Multisource Setup mit REST APIs, Kafka Eventstreams, SQL Datenbanken, usw. – aufgebaut im domänenübergreifenden Hub and Spoke System und ausgerichtet auf einen Single Point of Truth. Die Architektur verbindet dabei die SAP Lakehouse Welten mit hochfrequenten Engineering Datenströmen. Besonders im Engineering steht Self Service in Echtzeit Dashboards mit KQL Querysets im Mittelpunkt, um Fachbereiche nachhaltig zu befähigen.

Greta ist Psychologin und Transformationsbegleiterin und begleitet Menschen und Organisationen dabei, zukunftsfähige Zusammenarbeitskultur zu entwickeln – nicht durch blinden Aktionismus, sondern durch die richtige Balance zwischen Bewährtem und Neuem.

Impuls-Keynote und interaktiver Workshop. Umgang mit Mitarbeiterwiderständen bei der KI-Einführung durch praktisches Change Management und neue Führungsmethoden.

Matthias ist Partner bei HRpepper Berlin und einer der erfahrensten Köpfe, wenn es um Organisationsentwicklung und Transformation geht. Seit über 15 Jahren begleitet er Führungskräfte, Teams und Organisationen durch komplexe Veränderungen. Strukturell, prozessual und menschlich. Immer mit seinem Anspruch: Lösungen, die in der Realität funktionieren und nachhaltig wirken.

Impuls-Keynote und interaktiver Workshop. Umgang mit Mitarbeiterwiderständen bei der KI-Einführung durch praktisches Change Management und neue Führungsmethoden.

Als Bergsteiger ist Alexander Huber in der steilen Welt der Berge körperlich wie auch mental oft genug an die Grenzen gegangen. Es ist eben nicht nur die physische Kraft, die einen erfolgreichen Bergsteiger auszeichnet, sondern ganz im Gegenteil: die wahren Pioniere waren schon immer diejenigen mit der größten visionären Kraft! Dabei ist es mehr als offensichtlich, dass sich Ideen und Visionen nur dann erfolgreich umsetzen lassen, wenn geschickte Strategie und Planung die Grundlage bilden – nur so lässt sich das vorhandene Potential voll ausschöpfen. Die dazu notwendige Motivation wird dabei immer nur von der grundsätzlichen Freude am Schaffen generiert: die Passion als Quelle der Kraft! Das eingespielte Team Alexander und Thomas beginnt sich bereits in ihrer Kindheit zu bilden. Sie suchen gemeinsam nach Herausforderungen und tragen als Seilpartner aber dennoch Eigenverantwortung. Die Passion Berg steht als Metapher für das Leben und lässt Raum für Betrachtungen von beeindruckend bildgewaltigen Standpunkten… Denn es ist nicht der Berg, den man bezwingt, sondern immer nur das eigene Ich!

Extrembergsteiger und Diplom-Physiker Alexander Huber beschließt den World of Data mit seiner Closing-Keynote „Am Limit“ und verbindet die Welt der extremen Felswände mit Deinen Data-Business-Herausforderungen. Er zeigt, wie visionäre Kraft, sorgfältige Vorbereitung und ein eingespieltes Team helfen, Risiken klug zu managen, Resilienz zu entwickeln und ambitionierte Ziele zu erreichen – auf dem Berg ebenso wie in komplexen Datenprojekten.

Désirée ist Strategy & Transformation Managerin bei idealo internet GmbH und Program Lead AI Enablement. Sie sorgt dafür, dass KI im Unternehmen nicht bei einzelnen Initiativen stehen bleibt, sondern priorisiert, umgesetzt und skalierbar verankert wird. Dabei schafft sie die Strukturen und Steuerungsmechanismen, die aus KI-Initiativen messbaren Impact machen und fest in der täglichen Arbeit verankern. Neben ihrer Tätigkeit bei idealo ist sie Gründerin von blankspace. und moderiert unter anderem Formate rund um Transformation und Innovation.

Impuls-Keynote und interaktiver Workshop. Umgang mit Mitarbeiterwiderständen bei der KI-Einführung durch praktisches Change Management und neue Führungsmethoden.

Marco verantwortet als Senior Director den Digital & Innovation Hub bei Infineon und treibt dort seit 2017 die digitale Transformation und Innovationsthemen des Unternehmens voran. Seine vorherigen Stationen umfassen leitende Funktionen im Kooperations-, Produkt- und Projektmanagement bei ADAC Finanzdienste und ADAC Autovermietung sowie Beratungserfahrung bei EY.

Daniel ist seit mehr als 20 Jahren in der IT-Branche tätig und fokussiert sich dabei konsequent auf Partner Management und Business Development. Seit 5 Jahren treibt er bei IONOS den Aufbau des Partner-Ökosystems voran, verantwortet das gemeinsame Projektgeschäft und entwickelt Partner-managed PaaS- und SaaS-Services als strategische Erweiterung des IONOS Produktportfolios.

Viele Organisationen setzen auf globale Lösungen für die Speicherung, Verarbeitung und Analyse ihrer Daten. Gleichzeitig wächst das Bewusstsein für die Risiken einseitiger Abhängigkeiten:

- fehlende Interoperabilität und eingeschränkte Datenportabilität,

- Zugriffsgesetze, die Kontrolle über Daten untergraben und

- KI-Dienste ohne Transparenz über Datenverarbeitung und Rechtsrahmen.

Digitale Souveränität ist dabei mehr als eine technische Frage – sie ist eine politische und gesellschaftliche Notwendigkeit: die Fähigkeit von Staaten, Unternehmen und Verwaltungen, ihre digitalen Infrastrukturen und Daten eigenständig zu kontrollieren und selbstbestimmt als Gestaltungsmittel einzusetzen.

Wie können Dateninfrastrukturen so aufgebaut werden, dass sie Flexibilität, Skalierbarkeit und selbstbestimmte Nutzung ermöglichen – und gleichzeitig einseitige Abhängigkeiten vermeiden? In dieser 120-minütigen Masterclass zeigen vier Experten, wie mit state-of-the-art Technologien Datenpipelines, KI-Analyseplattformen und Cloud-Infrastrukturen souverän gestaltet werden können. Es werden strategische Entscheidungsgrundlagen und technische Umsetzungsmöglichkeiten vorgestellt und diskutiert.

Agenda

00:00 – 00:10 | Begrüßung & Keynote Souveränität beginnt beim Fundament

00:10 – 00:30 | Stackable Open Source Data Stack: Daten-Orchestrierung mit der Stackable Data Platform

00:30 – 00:50 | Red Hat OpenShift AI: Die souveräne Cloud-Plattform für geschäftskritische Daten- und KI-Workloads

00:50 – 01:10 | IONOS Der souveräne Cloud-Maschinenraum: Infrastruktur ohne Backdoor

01:10 – 01:30 | disy Informationssysteme Souveräne Datenanalyse: Die eigenen Daten als Gestaltungsmittel nutzen

01:30 – 02:00 | Deep Dive & Panel-Diskussion Quo vadis, Sovereign Stack?

Silvano ist Co-Founder und Managing Director von Kambria in Berlin und verantwortet den Bereich AI Transformation Enablement. Er unterstützt Unternehmen dabei, KI über Pilotprojekte hinaus in Prozesse, Rollen und den laufenden Betrieb zu überführen – mit Fokus auf Adoption, Governance sowie messbaren Geschäftsnutzen.

Fokus auf den echten ROI der KI-Transformation und strategische Priorisierung anhand von simplen Case Studies oder Expertenrunden.

Kai ist seit Mitte 2025 Solution Architect, Data & Analytics bei Karl Storz. Als ganzheitlich denkender, ergebnisorientierter Architekt konzentriert er sich auf Konzepte, Strategie und Governance – verankert in einem starken technischen Fundament. Er schlägt die Brücke zwischen KI, BI und geschäftlichen Anforderungen, um echten Mehrwert zu schaffen. Frühere Stationen umfassten kundennahe Beratung und Architektur in datengetriebenen Unternehmen.

Self Service Analytics verspricht Geschwindigkeit und Freiheit, doch führt bei wachsendem Erfolg schnell zu Unübersichtlichkeit. Auch bei Karl Storz sorgen viele Tools und immer mehr Dashboards dafür, dass Orientierung und Vertrauen leiden. Wir zeigen unseren aktuellen Lösungsansatz: den Schritt von einzelnen Dashboards hin zu klar definierten und zertifizierten Analytics Products.

Livia ist IT-Architektin mit Spezialisierung auf moderne Datenplattformen und skalierbare Analytics-Architekturen. Derzeit wirkt sie an der Entwicklung einer globalen Analytics-Plattform mit und gestaltet dabei Architekturprinzipien sowie Governance-Standards. Zuvor arbeitete sie als Data Engineer mit Schwerpunkt auf Requirements Engineering und enger Zusammenarbeit mit Fachbereichs-Stakeholdern. Ihre Arbeit umfasste die Integration und Modellierung von SAP- und CRM-Daten für analytische Datenplattformen.

Self Service Analytics verspricht Geschwindigkeit und Freiheit, doch führt bei wachsendem Erfolg schnell zu Unübersichtlichkeit. Auch bei Karl Storz sorgen viele Tools und immer mehr Dashboards dafür, dass Orientierung und Vertrauen leiden. Wir zeigen unseren aktuellen Lösungsansatz: den Schritt von einzelnen Dashboards hin zu klar definierten und zertifizierten Analytics Products.

Frank-Dieter ist Managing Partner der L&B Solutions GmbH und begleitet seit über 15 Jahren Unternehmen in IT- und Telekommunikationsprojekten. Sein Schwerpunkt liegt auf Programm , Projekt- und Change-Management, insbesondere in kritischen Projektlagen, Turnaround Situationen und Prozessoptimierungen.

Ehrliche Erfahrungsberichte über die Skalierung von KI-Projekten – von den Herausforderungen in der Praxis bis zu den Lessons Learned.

Jonathan verantwortet die MarTech-Architektur sowie die technische Steuerung bei Mytheresa, Net-A-Porter und Mr Porter. In seiner Rolle leitet er den Fachbereich für Tracking und Datenintegrität und fungiert als zentrale Schnittstelle zwischen Marketingzielen und technischer Strategie. Mit einem fundierten Hintergrund in CRM-Technologie, Performance-Marketing und Tracking gestaltet er das übergreifende Governance-Framework und definiert die strategische Ausrichtung des gesamten MarTech-Stacks.

Achieving a precise understanding of marketing impact often means moving beyond the limitations of standardized platforms. In this session, I will share how we designed and deployed a full-scale internal attribution framework at Mytheresa. I’ll walk through our approach to connecting scattered data sources, the engineering behind our unified tracking layer, and why we prioritized full ownership of our data and processes. We’ll look at the technical architecture and the practical steps we took to build a centralized system for a complete view of the customer journey.

Andreas ist Leiter Vertriebsentwicklung bei der MMV Leasing GmbH in Koblenz und verantwortet zudem Aufgaben im Team AI Finance. Er verbindet Mittelstandsfinanzierung mit den Themen Digitalisierung und Künstliche Intelligenz, treibt Vertriebsinitiativen voran und setzt Impulse zu Investitionen, Compliance sowie praxisnahen KI-Anwendungen.

Podiumsdiskussion und Publikums-Q&A. Diskussion über die Entscheidung zwischen Eigenentwicklung, Kauf und Kooperation mit Fokus auf Datensouveränität und DSGVO.

Caroline ist Chief Data Officer der Münchener Hypothekenbank eG. Nach ihrer Ausbildung zur Bankkauffrau und einem VWL-Studium in München und Madrid begann sie im Kreditrisikomanagement. Es folgten Jahre in der Bankenberatung sowie im Risikocontrolling, wo sie einen zentralen Datenhaushalt aufbaute und BCBS 239 umsetzte. Seit Januar 2024 verantwortet sie bei der MHB das fachliche Datenmanagement.

Viele Projekte zur Verbesserung der Datenarchitekturen in großen Unternehmen haben einen konkreten regulatorischen Ausgangspunkt oder starten mit definierten technischen Zielen – und kämpfen mit Problemen in der Umsetzung. Warum? Weil sie als reine Umsetzungsprojekte verstanden werden, obwohl ihr Kern in der Veränderung von Organisation, Kultur und Arbeitsweisen liegt. Dieser Vortrag beleuchtet, warum der Aufbau eines nachhaltigen Datenmanagements weit mehr ist als die Einführung von Tools und Prozessen. Im Fokus steht der oft unterschätzte Change-Charakter von derartigen Initiativen wie beispielsweise der Umsetzung von BCBS 239 in der Bankenwelt: von der Etablierung klarer Verantwortlichkeiten über den Umgang mit Widerständen bis hin zur Verankerung von einem nachhaltigen Umgang mit Datenqualität im täglichen Handeln. Anhand praxisnaher Erfahrungen wird aufgezeigt, woran Datenprogramme typischerweise scheitern – und welche Erfolgsfaktoren entscheidend sein können, um sie wirksam und nachhaltig umzusetzen. Teilnehmer erhalten konkrete Impulse, wie sie den notwendigen Wandel aktiv gestalten und die Umsetzung damit zum Erfolg führen können.

Jonas ist Data Scientist und Product Owner bei OTTO, wo er seit 2023 an verschiedenen Produkten im Kontext Marketing-Optimierung und Kundenanalyse mitgewirkt hat. Aktuell verantwortet er die Entwicklung und Anwendung der Customer Lifetime Values (CLV). Vor OTTO arbeitete er fünf Jahre bei L’Oréal, ebenfalls an Analytics-Themen in den Rollen Data Analyst und Data Scientist.

Um Budgets gezielt nach Kundenpotenzial einzusetzen, braucht es eine individuelle Profitabilitätsbewertung auf Einzelkundenebene. Seit diesem Geschäftsjahr setzt OTTO ein neues statistisches CLV-Modell ein, das den Kundenwert konkret als erwarteten Profit des kommenden Jahres definiert und individuell vorhersagt. Damit wird eine differenzierte Ansprache je nach Potenzial ermöglicht, ob im CRM, Customer Care oder bei Marketingentscheidungen. Im Vortrag beleuchten wir neben dem technischen Hintergrund vor allem unsere praktischen Erfahrungen in der Anwendung. Ein besonderes Augenmerk liegt dabei auf dem Change Management: Die Steuerung nach einem prognostischen Profit-CLV erfordert an einigen Stellen ein echtes Umdenken und genau darin liegt eine der spannendsten Herausforderungen dieses Projekts.

Kolja ist bei Rameder für die Datenstrategie, das Datenteam und die greenfield Data & Analytics-Plattform verantwortlich. Bevor er zu Rameder kam, führte er das Data Foundation-Team bei MediaMarktSaturn. Dort leitete er die Migration vom Legacy-DWH zur neuen Cloud-Datenplattform. Seine Laufbahn begann Kolja in der IT-Beratung, wo er in 10 Jahren Datenlösungen für zahlreiche Kunden erarbeitete.

Wie bei vielen Unternehmen im kleineren Mittelstand war die Datenwelt bei Rameder bis Herbst 2024 eine heterogene Insellandschaft. SAP im Zentrum, mehrere Cloud-Services wie Google Analytics rund herum und einzelne - von verschiedenen Bereichen aufgebaute - Datenbanken dazwischen. Um systemübergreifende Analysen in hoher Qualität zu ermöglichen, wurde Ende 2024 die Entscheidung für eine Greenfield-Datenplattform in der Google Cloud getroffen.

Der Vortrag zeigt die Plattformarchitektur und den Ansatz, wie alle Datenquellen an die neue Datenplattform angebunden werden konnten. Die größte Herausforderung war dabei die Integration von SAP BW. Zusätzlich enthielt es die meiste zu migrierende Geschäftslogik. Daher schauen wir uns dort die Details an, inkl. erstem fehlgeschlagenen Pilotprojekt und der erfolgreichen zweiten Lösung.

Nach Abschluss seines Masterstudiums in Maschinenbau, Wirtschaftswissenschaften und Automobilmanagement begann Detlev seine Karriere bei Vodafone und Colt Telecom im Bereich Service Provider. Ab 1999 hatte er verschiedene internationale Vertriebsaufgaben bei Cisco inne, wo er für globale Kunden zuständig war und das Service-Provider-Team leitete. 2017 wechselte er zu Arista Networks, wo er das Emerging EMEA Sales Team leitete, dessen Schwerpunkt auf KI-gesteuerter Netzwerkautomatisierung und -verwaltung lag. Seit 2025 ist er bei Red Hat im EMEA AI Platform Team als Sales Specialist tätig.

Viele Organisationen setzen auf globale Lösungen für die Speicherung, Verarbeitung und Analyse ihrer Daten. Gleichzeitig wächst das Bewusstsein für die Risiken einseitiger Abhängigkeiten:

- fehlende Interoperabilität und eingeschränkte Datenportabilität,

- Zugriffsgesetze, die Kontrolle über Daten untergraben und

- KI-Dienste ohne Transparenz über Datenverarbeitung und Rechtsrahmen.

Digitale Souveränität ist dabei mehr als eine technische Frage – sie ist eine politische und gesellschaftliche Notwendigkeit: die Fähigkeit von Staaten, Unternehmen und Verwaltungen, ihre digitalen Infrastrukturen und Daten eigenständig zu kontrollieren und selbstbestimmt als Gestaltungsmittel einzusetzen.

Wie können Dateninfrastrukturen so aufgebaut werden, dass sie Flexibilität, Skalierbarkeit und selbstbestimmte Nutzung ermöglichen – und gleichzeitig einseitige Abhängigkeiten vermeiden? In dieser 120-minütigen Masterclass zeigen vier Experten, wie mit state-of-the-art Technologien Datenpipelines, KI-Analyseplattformen und Cloud-Infrastrukturen souverän gestaltet werden können. Es werden strategische Entscheidungsgrundlagen und technische Umsetzungsmöglichkeiten vorgestellt und diskutiert.

Agenda

00:00 – 00:10 | Begrüßung & Keynote Souveränität beginnt beim Fundament

00:10 – 00:30 | Stackable Open Source Data Stack: Daten-Orchestrierung mit der Stackable Data Platform

00:30 – 00:50 | Red Hat OpenShift AI: Die souveräne Cloud-Plattform für geschäftskritische Daten- und KI-Workloads

00:50 – 01:10 | IONOS Der souveräne Cloud-Maschinenraum: Infrastruktur ohne Backdoor

01:10 – 01:30 | disy Informationssysteme Souveräne Datenanalyse: Die eigenen Daten als Gestaltungsmittel nutzen

01:30 – 02:00 | Deep Dive & Panel-Diskussion Quo vadis, Sovereign Stack?

Markus leitet das Analytics Solution Engineering Team für Salesforce / Tableau in Deutschland und Österreich. Er ist seit über acht Jahren bei Salesforce tätig. Vor seiner Tätigkeit bei Salesforce arbeitete er viele Jahre bei IBM und SPSS in verschiedenen Positionen im Solution Engineering und Management auf nationaler, regionaler und globaler Ebene. Ein wichtiger Schwerpunkt seiner gesamten Laufbahn war es, Erkenntnisse und Einblicke für das Unternehmen zu gewinnen, um mithilfe von Analytics und KI / maschinellem Lernen bessere Entscheidungen zu ermöglichen.

Weitere Informationen folgen in Kürze.

Mit über 23 Jahren internationaler Erfahrung im Bereich Datenmanagement hat Dominic einen Weg eingeschlagen, der mit Prozessmanagement, Automatisierung und Integration begann und zu einem umfassenden Verständnis des Datenmanagements führte, das Datenintegration, Datenqualität, Datenbeobachtbarkeit, Datenstammverwaltung, Datenmarktplätze sowie KI/ML umfasst. Auf dem heutigen Markt unterstreicht das Aufkommen von KI und GPT die Bedeutung eines soliden Verständnisses der Prinzipien des Datenmanagements, um die Vertrauenswürdigkeit, Verantwortlichkeit und ethische Nutzung von KI-Technologien sicherzustellen.

Every company can rent an AI model, but only those who own their context will dominate the market. The hurdle to AI success isn't a lack of data—we're all drowning in it! It's a context problem: when agents and apps lack a unified data foundation, the result is disjointed experiences, costly mistakes, and hallucinations. In this session, you'll discover how to move from data chaos to operational confidence by engineering a foundation where data is seamlessly integrated via Informatica, unified with Data 360, and visualized through Tableau.

Masterclass Session 1 — Informatica

Title: Unlock Trusted Context with Salesforce and Informatica

Abstract: Join us to discover how Salesforce and Informatica will help transform all your fragmented data and systems into a powerful engine that delivers trusted context to every corner of your enterprise.

Speaker: Dominic Walter

Masterclass Session 2 — Data 360

Title: Activate Trusted Context Everywhere with Data 360

Abstract: Discover how Data 360 activates trusted data and context from any data source, empowering your teams, AI, and systems to deliver personalized experiences that drive measurable business growth.

Speaker: Ahmed Keshk

Masterclass Session 3 — Analytics

Title: Activate Conversational Analytics with Tableau Next

Abstract: Step into the era of the Agentic Enterprise. Explore how Agentforce Tableau unlocks conversational analytics, empowering you to ask questions and get instant, accurate, contextual insights.

Speaker: Manuel Parfant

Als Salesforce-CTA und seit 20 Jahren im CRM-Bereich tätiger Experte hat Ahmed zwei Jahrzehnte lang im Bereich Professional Services verbracht und dort groß angelegte digitale Transformationen geleitet. Heute konzentriert er sich auf Salesforce Data 360 und verbindet fundierte Kenntnisse im Bereich Data Engineering mit architektonischem Fachwissen, um Marken dabei zu unterstützen, im Zeitalter von Daten und KI erfolgreich zu sein.

Every company can rent an AI model, but only those who own their context will dominate the market. The hurdle to AI success isn't a lack of data—we're all drowning in it! It's a context problem: when agents and apps lack a unified data foundation, the result is disjointed experiences, costly mistakes, and hallucinations. In this session, you'll discover how to move from data chaos to operational confidence by engineering a foundation where data is seamlessly integrated via Informatica, unified with Data 360, and visualized through Tableau.

Masterclass Session 1 — Informatica

Title: Unlock Trusted Context with Salesforce and Informatica

Abstract: Join us to discover how Salesforce and Informatica will help transform all your fragmented data and systems into a powerful engine that delivers trusted context to every corner of your enterprise.

Speaker: Dominic Walter

Masterclass Session 2 — Data 360

Title: Activate Trusted Context Everywhere with Data 360

Abstract: Discover how Data 360 activates trusted data and context from any data source, empowering your teams, AI, and systems to deliver personalized experiences that drive measurable business growth.

Speaker: Ahmed Keshk

Masterclass Session 3 — Analytics

Title: Activate Conversational Analytics with Tableau Next

Abstract: Step into the era of the Agentic Enterprise. Explore how Agentforce Tableau unlocks conversational analytics, empowering you to ask questions and get instant, accurate, contextual insights.

Speaker: Manuel Parfant

Als Principal Solution Engineer bringt Manuel fundierte Fachkenntnisse in der Förderung technologischer Innovationen und dem Aufbau langfristiger Kundenpartnerschaften in der DACH-Region mit. Als ehemaliger Plattformverantwortlicher und Tableau-Teamleiter bei Infineon leitete er die erfolgreiche Einführung und Ausweitung von Tableau und baute die Nutzerzahl auf über 30.000 aktive Nutzer aus. Mit seinem Hintergrund in der Softwareentwicklung verbindet Manuel fundiertes technisches Wissen mit der Leidenschaft, innovative Lösungen für komplexe unternehmerische Herausforderungen zu liefern. Als mehrfacher Preisträger für herausragende Leistungen ist er für sein Engagement für transformative Ergebnisse bekannt.

Every company can rent an AI model, but only those who own their context will dominate the market. The hurdle to AI success isn't a lack of data—we're all drowning in it! It's a context problem: when agents and apps lack a unified data foundation, the result is disjointed experiences, costly mistakes, and hallucinations. In this session, you'll discover how to move from data chaos to operational confidence by engineering a foundation where data is seamlessly integrated via Informatica, unified with Data 360, and visualized through Tableau.

Masterclass Session 1 — Informatica

Title: Unlock Trusted Context with Salesforce and Informatica

Abstract: Join us to discover how Salesforce and Informatica will help transform all your fragmented data and systems into a powerful engine that delivers trusted context to every corner of your enterprise.

Speaker: Dominic Walter

Masterclass Session 2 — Data 360

Title: Activate Trusted Context Everywhere with Data 360

Abstract: Discover how Data 360 activates trusted data and context from any data source, empowering your teams, AI, and systems to deliver personalized experiences that drive measurable business growth.

Speaker: Ahmed Keshk

Masterclass Session 3 — Analytics

Title: Activate Conversational Analytics with Tableau Next

Abstract: Step into the era of the Agentic Enterprise. Explore how Agentforce Tableau unlocks conversational analytics, empowering you to ask questions and get instant, accurate, contextual insights.

Speaker: Manuel Parfant

Mit über fünf Jahren Erfahrung an der Schnittstelle von KI-Strategie und technischer Lösungsentwicklung hat Christoph Organisationen in verschiedensten Branchen dabei unterstützt, Daten in echten geschäftlichen Mehrwert zu verwandeln – von der Beratung zu Enterprise-KI-Governance bis hin zur Entwicklung und Implementierung produktionsreifer KI-Anwendungen. Heute ist er auf Generative KI spezialisiert und hilft Unternehmen, die Komplexität von Enterprise-KI zu durchdringen.

What if the biggest barrier to enterprise AI wasn't your data, your budget, or your team—but the platform itself? The organizations winning with AI today aren't the ones with the most engineers. They're the ones who removed the friction between their data and their intelligence. In this session, we cut through the noise of AI hype and show you what enterprise AI looks like when it actually works. We'll demonstrate how any team—from business analysts to data engineers—can build, deploy, and govern AI applications directly on their data, without moving it, without complexity, and without compromise.

What you will experience:

1) From Question to Action: How natural language replaces complex queries—and how AI goes beyond just answering to proactively surfacing the insights that matter.

2) Building at AI Speed: How modern data teams move from idea to working AI application in minutes, not months.

3) Governance Without the Overhead: Why enterprise AI only scales when security, trust, and cost controls are built in from day one—not bolted on later.

Who should attend?

Whether you're a data leader shaping your AI strategy, an engineer looking to move faster, or a business stakeholder tired of waiting days for insights—this session will show you that enterprise AI doesn't have to be hard.

Stefan ist Head of Data Strategy & Analytics bei der SPAR Österreich Gruppe. In dieser Rolle gestaltet er die Weiterentwicklung der Data Analytics Strategie und den Einsatz moderner Datenplattformen. Dabei begleitet er die Transformation der Analytics-Landschaft sowie die Umsetzung der SPAR-Datenstrategie in Organisation und Kultur.

In diesem Vortrag geben wir Einblicke in die Datenreise bei SPAR und zeigen, wie wir datengetriebenes Arbeiten im Unternehmen neu denken. Dabei beleuchten wir, wie aus isolierten Datenquellen eine vernetzte Datenlandschaft entsteht, welche organisatorischen und technologischen Veränderungen dafür notwendig waren. Anhand konkreter Beispiele zeigen wir, wie aus Daten echter Mehrwert entsteht, und welche Learnings wir auf diesem Weg mitgenommen haben.

Sönke brings years of hands-on experience in Big Data, supporting customers in designing and implementing solutions while actively contributing to open source projects. His deep involvement in building and maintaining infrastructures has given him broad insight into the diverse needs and conditions that shape effective Big Data architectures. As CPO at Stackable, he channels this expertise into the product to ensure it fully meets the needs of every customer.

Viele Organisationen setzen auf globale Lösungen für die Speicherung, Verarbeitung und Analyse ihrer Daten. Gleichzeitig wächst das Bewusstsein für die Risiken einseitiger Abhängigkeiten:

- fehlende Interoperabilität und eingeschränkte Datenportabilität,

- Zugriffsgesetze, die Kontrolle über Daten untergraben und

- KI-Dienste ohne Transparenz über Datenverarbeitung und Rechtsrahmen.

Digitale Souveränität ist dabei mehr als eine technische Frage – sie ist eine politische und gesellschaftliche Notwendigkeit: die Fähigkeit von Staaten, Unternehmen und Verwaltungen, ihre digitalen Infrastrukturen und Daten eigenständig zu kontrollieren und selbstbestimmt als Gestaltungsmittel einzusetzen.

Wie können Dateninfrastrukturen so aufgebaut werden, dass sie Flexibilität, Skalierbarkeit und selbstbestimmte Nutzung ermöglichen – und gleichzeitig einseitige Abhängigkeiten vermeiden? In dieser 120-minütigen Masterclass zeigen vier Experten, wie mit state-of-the-art Technologien Datenpipelines, KI-Analyseplattformen und Cloud-Infrastrukturen souverän gestaltet werden können. Es werden strategische Entscheidungsgrundlagen und technische Umsetzungsmöglichkeiten vorgestellt und diskutiert.

Agenda

00:00 – 00:10 | Begrüßung & Keynote Souveränität beginnt beim Fundament

00:10 – 00:30 | Stackable Open Source Data Stack: Daten-Orchestrierung mit der Stackable Data Platform

00:30 – 00:50 | Red Hat OpenShift AI: Die souveräne Cloud-Plattform für geschäftskritische Daten- und KI-Workloads

00:50 – 01:10 | IONOS Der souveräne Cloud-Maschinenraum: Infrastruktur ohne Backdoor

01:10 – 01:30 | disy Informationssysteme Souveräne Datenanalyse: Die eigenen Daten als Gestaltungsmittel nutzen

01:30 – 02:00 | Deep Dive & Panel-Diskussion Quo vadis, Sovereign Stack?

Nancy ist Senior Data Engineer bei den Stadtwerken Düsseldorf. Sie betreut fachliche Use Cases von der Anforderung bis zur produktiven ETL-Pipeline – mit Fokus auf Data Mesh, Data Vault 2.0 und messbarem Business Value. Ihre Technologien sind Databricks, dbt Labs und Azure Services.

Daten entscheiden. Aber wer darf sie sehen? In vielen Unternehmen lautet die ehrliche Antwort: die IT – und sonst kaum jemand.

Dieser Vortrag ist für alle, die das ändern wollen. Ich erzähle, warum Self-Service Analytics bei uns zunächst gescheitert ist, was wir intern überwinden mussten – und wie es am Ende doch funktioniert hat. Kein technischer Deep-Dive, sondern eine ehrliche Geschichte über Daten, Verantwortung und die Frage: Wem gehören eigentlich die Erkenntnisse in deinem Unternehmen?

Ulisse ist Regional VP Solution Consulting EMEA bei Tealium und verfügt über mehr als 15 Jahre Erfahrung in Softwareentwicklung und Solution Consulting. Er ist darauf spezialisiert, Unternehmen bei der Nutzung von KI und Echtzeit-Datenorchestrierung zu unterstützen, um vertrauenswürdige, klar geregelte Datenfundamente aufzubauen, die intelligentere und stärker personalisierte Kundenerlebnisse ermöglichen. Mit Expertise in den Bereichen CDP, MarTech und AdTech ist Ulisse ein anerkannter Vordenker und Sprecher, der Innovation an der Schnittstelle von KI und Datenaktivierung vorantreibt.

Birgitta arbeitet bei Telefónica Germany im Bereich AI, Analytics und BI Platforms. Sie verantwortet cloud-native KI-Architekturen mit Azure und Databricks und zeigt, wie GenAI über DevOps, Governance und Security auch in hochregulierten Umgebungen produktiv betrieben werden kann.

KI in stark regulierten Umgebungen erfolgreich einzusetzen erfordert mehr als Technologie. In diesem Beitrag stellen wir unser praxiserprobtes Framework vor, das KI ganzheitlich von Strategie und Use‑Case‑Priorisierung über Governance, Compliance und Architektur bis hin zum sicheren Betrieb betrachtet. Anhand konkreter Beispiele zeigen wir, wie Organisationen mit klaren Leitplanken Innovation ermöglichen, regulatorische Anforderungen erfüllen und nachhaltigen Business‑Mehrwert aus KI schaffen.

Franz ist Senior Process Manager im Bereich DevOps mit Schwerpunkt Cloud, Machine Learning und AI. Er gestaltet strategische cloud-native Transformationen, optimiert End-to-End-DevOps-Prozesse und arbeitet eng mit Security, Datenschutz und Betriebsrat zusammen, um moderne KI- und Cloud-Architekturen sicher, compliant und nachhaltig in Unternehmen zu verankern.

KI in stark regulierten Umgebungen erfolgreich einzusetzen erfordert mehr als Technologie. In diesem Beitrag stellen wir unser praxiserprobtes Framework vor, das KI ganzheitlich von Strategie und Use‑Case‑Priorisierung über Governance, Compliance und Architektur bis hin zum sicheren Betrieb betrachtet. Anhand konkreter Beispiele zeigen wir, wie Organisationen mit klaren Leitplanken Innovation ermöglichen, regulatorische Anforderungen erfüllen und nachhaltigen Business‑Mehrwert aus KI schaffen.

Ursprünglich aus Australien und mittlerweile in Berlin ansässig, hat Tobias mit zahlreichen internationalen Unternehmen daran gearbeitet, eine datengetriebene Kultur zu etablieren. Tobias Hingston ist Senior Product Analyst bei Tonies, wo er die Analytics-Aktivitäten für globale Markteinführungen sowohl physischer als auch digitaler Produkte geleitet hat. Tobias hat skalierbare Dateninfrastrukturen aufgebaut und Daten fest im Produktentwicklungszyklus verankert. Zuvor trieb er bei Klarna durch Product Analytics und Experimente die Nutzerakquise und Produktoptimierung voran und arbeitete dabei an Klarnas Banking- und Sparprodukten.

This talk looks back at the fast-track implementation and activation of Amplitude Analytics at Tonies across web and app in a strong e-commerce context. Starting from the challenges of the previous analytics setup, including low trust in numbers and limited stakeholder adoption. The session shows how Tonies rolled out Amplitude in just two weeks with the right team and setup.

The second half of the talk follows what happened one year since implementation, we reflect on the initial learnings, getting company buy-in before a company-wide rollout, concrete product analytics use cases and the role of integrations such as Braze. The talk shows how the Analytics platform evolved from selected use cases into a trusted analytics capability, supporting trend validation, issue identification, experimentation, and better product and customer decisions.

Till ist Chief Operating Officer und Mitbegründer von Veezoo, der agentenbasierten Analyseplattform, die Fragen in natürlicher Sprache in verlässliche Insights für Tausende von Nutzern weltweit verwandelt. Er ist für Betrieb, Wachstum und Kundenerfolg verantwortlich und stellt sicher, dass Veezoo seine Mission erfüllt: mehr Menschen dabei zu unterstützen, bessere Entscheidungen mit Vertrauen zu treffen. Heute unterstützt Veezoo Vertriebs- und Analyseteams bei Branchenführern wie AXA, BMW, Breitling, Valora und vielen anderen.

For over a decade, organizations have pursued data democratization with varying degrees of success.

While traditional BI tools laid the groundwork, the rapid emergence of Agentic AI is now reshaping what is possible, moving us from static reporting to active, intelligent conversation.

In this session, we will explore what this shift looks like in practice, drawing on real-world examples of organizations that have moved beyond dashboards to an agentic analytics approach. We will look at what drives genuine adoption, how governance and trust scale alongside broader access, and what changes when every team in the organization can finally talk to their data without waiting for a report.

Als Head of Digital People, Culture bei der WACKER Chemie AG in München ist Julia verantwortlich für die erfolgreiche Einführung von Daten‑, Analytics‑ und KI‑Lösungen und legt dabei einen klaren Fokus auf den Menschen als entscheidenden Erfolgsfaktor. Ihre Schwerpunkte liegen auf nachhaltiger Nutzung, messbarem Erfolg und der Entwicklung einer starken Daten‑ und Veränderungskultur.

Unternehmen investieren in Daten, KI und digitale Tools – doch die Wirkung hängt von einer tatsächlichen Verhaltensänderung bei den Mitarbeitenden ab. In diesem Beitrag erläutert Julia Pogorzelski, User Adoption Expert bei WACKER, was Benutzerakzeptanz wirklich bedeutet – nicht nur die Einführung von Tools, sondern eine menschenzentrierte Förderung von Bewusstsein, Fähigkeiten und nachhaltiger Nutzung. Sie erfahren, wie Sie den Erfolg messen, KPIs an den Akzeptanzergebnissen ausrichten und Ängste und psychologische Biases angehen können, die die digitale Akzeptanz behindern. Anhand realer Fälle, wie der Einführung von MS Copilot, erleben Sie, wie die Prinzipien von User Adoption zielgerichtet eingesetzt werden und dadurch Kompetenz, Transformation und Kultur gefördert werden.

Tim ist seit mehr als 15 Jahren im Bereich Business Intelligence tätig. Über die Zeit hat sich sein Aufgabenschwerpunkt von der Erstellung von Reports und Dashboards, über die Projektarbeit mit dem Fokus auf neue Informationssysteme hin zu dem Aufbau einer BI Platform verändert. Hierzu zählt die erfolgreiche globale Einführung und Etablierung von Power BI als Analyse-/ Reporting Platform bei Weidmüller und ganz aktuell, der Aufbau einer Data Platform basierend auf Microsoft Fabric. Hierbei liekt aktuell sein Fokus auf der Entwicklung und Etablierung einer Platform Strategie und einer Platform Governance.

Der Vortrag „Schatzkarte statt Datendschungel – Organisation & Data Catalog als Erfolgsfaktor“ beginnt mit einer Reise in die Vergangenheit und die Evolution der Data und Analytics Plattform bei Weidmüller wird umrissen. Anschließend wird die gegenwärtige Organisation dargestellt und Erfolgsfaktoren bei der Realisierung benannt. Zudem wird der mit Microsoft Tools eigenständig entwickelte Data Catalog – der an den Bedarfen im Unternehmen ausgerichtet ist – vorgestellt.